Ohne Crawling keine Indexierung – und ohne Indexierung keine Rankings: Damit Seiten in den Search Engine Result Pages (SERPs) erscheinen können, müssen sie zunächst von Suchmaschinen erfasst und verarbeitet werden.

Unser Artikel behandelt die gängigen Fragen und Probleme rund ums Crawl Budget und bietet einen praxisnahen Fahrplan, um die Indexierungs-Effizienz zu steigern.

Ein Suchmaschinen-Crawler ruft URLs ab, analysiert Inhalte, interne Verlinkungen sowie technische Signale und entscheidet anschließend, ob und wie eine Seite in den Index aufgenommen wird. Entscheidend für die Indexierung ist das Crawl Budget. Es beschreibt die Anzahl an URLs, die eine Suchmaschine über ihren Crawler – etwa den Googlebot – innerhalb eines bestimmten Zeitraums auf einer Website oder in einem E-Commerce-Shop abruft und potenziell indexiert. Es setzt sich aus der Crawl-Rate und dem Crawl-Bedarf zusammen.

Insbesondere bei großen Websites oder Shops mit tausend oder mehr URLs ist ein effizientes Crawl Management entscheidend, damit strategisch relevante Seiten priorisiert erfasst werden, während irrelevante oder redundante URLs keine wertvollen Crawl-Ressourcen binden. Das von Suchmaschinen investierte Crawl Budget steht dabei nicht automatisch im Verhältnis zur Größe einer Website.

Was ist das Crawl Budget?

Das Crawl Budget ist kein fester Wert, sondern das Ergebnis aus technischer Infrastruktur und algorithmischer Bewertung. Suchmaschinen bewerten kontinuierlich, wie intensiv eine Domain gecrawlt werden kann und soll. Ziel ist es, neue oder aktualisierte Inhalte effizient zu erfassen, ohne Server zu überlasten oder unnötige Ressourcen zu verschwenden.

Im Kern setzt sich das Crawl Budget aus zwei Komponenten zusammen: der Crawl-Rate und dem Crawl-Bedarf. Beide wirken dynamisch zusammen und bestimmen, wie häufig und in welcher Tiefe der Googlebot eine Website besucht.

Crawl-Rate (Crawl Rate Limit)

Die Crawl-Rate beschreibt das technische Limit, mit dem ein Crawler innerhalb eines bestimmten Zeitraums Anfragen an eine Website stellen kann. Sie definiert, wie intensiv eine Domain gecrawlt werden kann, ohne die Performance zu beeinträchtigen. Sie wird maßgeblich durch die Serverstabilität und -geschwindigkeit beeinflusst. Relevante Einflussfaktoren auf die Crawl-Rate sind unter anderem:

- Server-Response-Zeit (Time to First Byte / Antwortgeschwindigkeit des Servers)

- Häufigkeit von 5xx-Fehlern (z. B. „500 Internal Server Error“ oder „503 Service Unavailable“)

- Timeouts oder Verbindungsabbrüche (Server beantwortet Anfragen nicht rechtzeitig)

- allgemeine Hosting-Qualität (Stabilität, Ressourcen, Skalierbarkeit der Infrastruktur)

Reagiert ein Server langsam oder instabil, reduziert Google automatisch die Crawl-Intensität, um die Website nicht zusätzlich zu belasten. Eine performante Infrastruktur signalisiert hingegen, dass mehr URLs effizient und parallel abgerufen werden können. Technisches SEO und saubere Serverkonfiguration sind daher direkte Hebel zur Stabilisierung und potenziellen Erhöhung der Crawl-Rate.

Crawl-Bedarf (Crawl Demand)

Der Crawl-Bedarf beschreibt, wie stark der Ranking-Algorithmus einer Suchmaschine an einer Domain oder einzelnen URLs interessiert ist. Er bestimmt, welche Seiten priorisiert, in welchen Abständen erneut besucht und wie intensiv sie insgesamt gecrawlt werden sollen. Ein hoher Crawl-Bedarf ist grundsätzlich ein positives Signal: Er zeigt, dass eine Website als relevant, vertrauenswürdig und potenziell rankingfähig eingestuft wird. Je höher dieses algorithmische Interesse, desto häufiger investiert die Suchmaschine Ressourcen in das erneute Crawling. Ein hoher Crawl-Bedarf entsteht typischerweise durch:

- regelmäßig aktualisierte und qualitativ hochwertige Inhalte

- eine starke interne Verlinkung mit klarer Priorisierung

- externe Backlinks als Autoritäts- und Vertrauenssignal

- hohe Nutzerrelevanz und positive Interaktionssignale

- eine strukturierte, nachvollziehbare Informationsarchitektur

Aktualisierte oder stark verlinkte Seiten werden häufiger erneut gecrawlt, da Suchmaschinen hier eine höhere Wahrscheinlichkeit für neue oder relevante Inhalte vermuten. URLs ohne erkennbare Qualitäts- oder Aktualitätssignale werden entsprechend seltener berücksichtigt. Ein steigender Crawl-Bedarf deutet darauf hin, dass eine Website nicht nur technisch zugänglich ist, sondern auch inhaltlich und strategisch als relevant eingestuft wird.

Das Crawl Budget ist kein direkter Rankingfaktor. Es beeinflusst nicht unmittelbar die Position einer Seite in den Suchergebnissen, sondern die technischen Voraussetzungen für eine vollständige und zeitnahe Indexierung. Erst indexierte Inhalte können vom Ranking-Algorithmus bewertet werden.

Crawling, Indexierung und Ranking

Damit eine Seite in den Suchergebnissen erscheinen kann, durchläuft sie mehrere aufeinanderfolgende Prozesse.

- Beim Crawling ruft ein Suchmaschinen-Crawler eine URL ab und analysiert deren Inhalte sowie technische Signale. Dazu gehören unter anderem HTML-Struktur, Metadaten, interne und externe Verlinkungen sowie strukturierte Daten. Auf Basis dieser Analyse entscheidet die Suchmaschine, ob und in welcher Form die Seite in den Index aufgenommen wird.

- Die Indexierung bedeutet, dass eine URL in der Datenbank der Suchmaschine gespeichert und für potenzielle Rankings berücksichtigt wird. Erst indexierte Seiten können grundsätzlich in den Suchergebnissen erscheinen.

- Das Ranking wiederum bestimmt die konkrete Position innerhalb der Search Engine Result Pages (SERPs). Dabei bewertet der Algorithmus zahlreiche Faktoren wie Relevanz, Qualität, Autorität und Nutzerintention.

Crawling ist somit die technische Voraussetzung für Indexierung und Indexierung die Voraussetzung für ein Ranking. Wird eine URL nicht oder nur unvollständig gecrawlt, kann sie nicht korrekt indexiert werden. Genau an dieser Stelle gewinnt das Crawl Budget an strategischer Bedeutung für SEO.

Google Crawl Budget im Kontext

Auch wenn grundsätzlich jede Suchmaschine eigene Crawler und Ressourcenlimits besitzt, steht bei der Bewertung von Crawl Budget, Indexierung und Ranking in der Regel das Google Crawl Budget im Fokus. Das liegt daran, dass Google in vielen Märkten den organischen Suchtraffic maßgeblich dominiert und die Crawling-Entscheidungen des Googlebot erheblichen Einfluss auf Sichtbarkeit und Reichweite haben.Wie oft crawlt der Googlebot?

Eine pauschale Crawling-Frequenz gibt es nicht. Google weist keiner Website ein fixes oder standardisiertes Crawl-Kontingent zu. Stattdessen wird die Crawling-Intensität dynamisch und individuell bestimmt.

Häufig aktualisierte oder besonders relevante Seiten können mehrmals täglich gecrawlt werden, während statische oder weniger bedeutende URLs teilweise nur in größeren Abständen erneut abgerufen werden. Große News-Portale oder stark frequentierte E-Commerce-Plattformen weisen daher in der Regel eine deutlich höhere Crawling-Frequenz auf als kleine, selten aktualisierte Websites.

Google Crawling-Frequenz verringern – geht das?

Eine manuelle Steuerung der Crawl-Rate über die Google Search Console ist im aktuellen Interface nicht mehr vorgesehen. Frühere Versionen der Google Search Console boten Website-Inhabern eine manuelle Einstellung zur Begrenzung der Crawl-Rate.

Google reguliert das Crawl Rate Limit automatisiert und passt die Intensität an Server-Performance und Website-Signale an. Eine Reduzierung ist nur noch in Ausnahmefällen über eine gesonderte Anfrage möglich, etwa bei akuten Serverproblemen. Sie sollte ausschließlich als kurzfristige Notfallmaßnahme verstanden werden, da sie die Erfassung neuer oder aktualisierter Inhalte verzögern kann.

Crawl Waste und Indexierungsrisiken erkennen und bewerten

Nicht jede Website leidet unter Crawl-Budget-Problemen. Bei kleineren oder strukturell klar aufgebauten Projekten ist das Thema häufig von untergeordneter Bedeutung. Relevanz entsteht in der Regel erst bei größeren Websites, umfangreichen E-Commerce-Shops, stark parameterisierten URL-Strukturen oder sehr dynamischen Content-Systemen. Bevor gezielte Optimierungen erfolgen, sollte daher geprüft werden, ob tatsächlich ein strukturelles Crawling- oder Indexierungsproblem vorliegt.

Ressourcenbindung durch irrelevante URLs

Kritisch wird es, wenn Crawling-Ressourcen durch URLs gebunden werden, die keinen strategischen Mehrwert liefern. Dazu zählen technisch erzeugte Parameter-URLs, facettierte Navigation mit nahezu unendlichen Filterkombinationen, fehlende oder inkonsistente Canonical-Tags, Weiterleitungsketten, Duplicate Content, Soft-404-Seiten oder fehlerhafte Statuscodes. Solche URLs können große Teile des Crawl Budgets absorbieren, ohne zur Sichtbarkeit beizutragen – ein klassischer Fall von Crawl Waste.

Crawling ohne Indexierung: „Gecrawlt, derzeit nicht indexiert“

Ein zentrales Indiz für Effizienzprobleme ist der Bericht „Gecrawlt – zurzeit nicht indexiert“ in der Google Search Console. Landen dort zahlreiche Seiten, die eigentlich relevant sein sollten – etwa Produktdetailseiten oder Kategorieseiten –, investiert Google zwar Crawling-Ressourcen, entscheidet sich jedoch gegen eine Indexierung. Ursachen können Qualitätsdefizite, interne Konkurrenz, unklare Canonical-Signale oder strukturelle Schwächen der Informationsarchitektur sein.Crawl Budget Optimierung im SEO

Die Optimierung des Crawl Budgets zielt darauf ab, vorhandene Crawling-Ressourcen effizient auf strategisch relevante URLs zu konzentrieren. Im Mittelpunkt steht dabei nicht die künstliche Ausweitung des Budgets, sondern eine klare Priorisierung: Wichtige Inhalte sollen schneller und vollständiger erfasst werden, während technisch oder qualitativ irrelevante URLs keine Ressourcen binden.

Probleme identifizieren

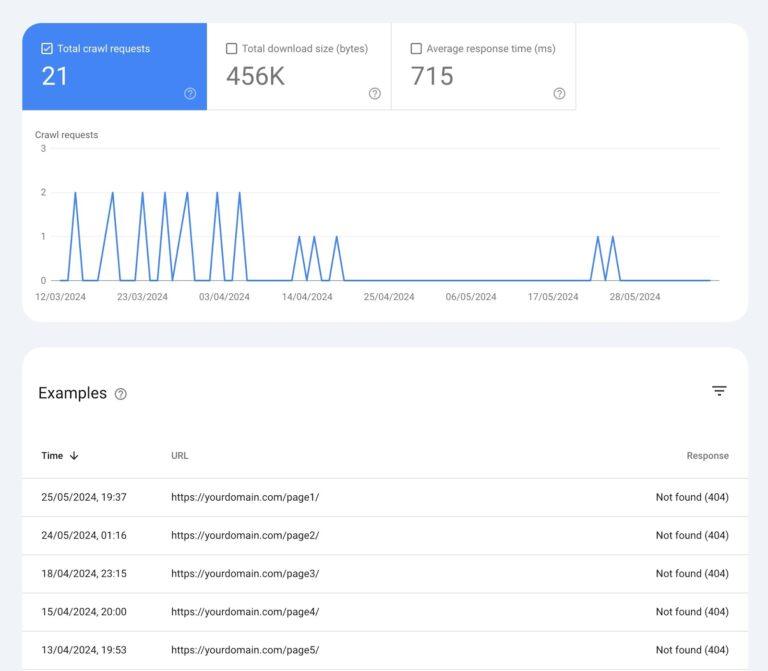

Vor der Umsetzung konkreter Maßnahmen ist eine strukturierte Analyse erforderlich, um bestehende Ineffizienzen im Crawling- und Indexierungsprozess klar zu verorten. Entscheidend ist die Bewertung, ob Crawling-Ressourcen auf strategisch relevante Inhalte oder auf redundante, technisch erzeugte Strukturen entfallen. Eine fundierte Einschätzung erfordert die Kombination mehrerer Datenquellen, insbesondere Logfile-Analysen und Crawling-Statistiken aus der Google Search Console. Erst wenn relevante Inhalte nicht ausreichend erfasst werden oder strukturelle Auffälligkeiten erkennbar sind, lässt sich eine gezielte und sinnvolle Strategie zur Optimierung des Crawl Budgets ableiten.

Zentrale Maßnahmen zur Optimierung

Auf Basis dieser Analyse lassen sich priorisierte Maßnahmen ableiten, die gezielt auf eine effizientere Verteilung der Crawling-Ressourcen einzahlen. Die wichtigsten Optimierungsansätze im Überblick:

| Bereich | Maßnahme |

| Technik, Server & Infrastruktur | Skalierbare Hosting-Infrastruktur sicherstellen |

| Server-Response-Zeit optimieren (TTFB) | |

| 5xx-Fehler und Timeouts minimieren | |

| Caching & Komprimierung einsetzen | |

| CDN sinnvoll konfigurieren | |

| URL-Struktur | Parameter-Handling bereinigen |

| Faceted Navigation steuern | |

| Konsistente Canonical-Tags setzen | |

| Statuscodes & Weiterleitungen | Redirect-Ketten auflösen |

| Soft-404-Probleme beheben | |

| Interne Struktur | Interne Verlinkung priorisieren |

| Klicktiefe reduzieren | |

| XML-Sitemap pflegen | |

| Content & Qualität | Thin Content bereinigen |

| Aktualisierungsfrequenz erhöhen |

In der Praxis ist Crawl-Budget-Optimierung ein Bestandteil der technischen SEO und abhängig von strukturellen sowie qualitativen Rahmenbedingungen. Grundlage bleibt in jedem Fall eine datenbasierte Analyse vor der Umsetzung.